产品概述

LangWatch是一款全面的LLM运维平台,帮助AI团队管理大语言模型(LLM)应用的全生命周期。平台可无缝集成任意技术栈,提供监控、评估与优化工具,确保AI质量、安全与性能。通过自动化质量检查、引入人工闭环评估和详尽分析,LangWatch帮助企业降低幻觉、数据泄露等AI风险,加速从概念验证到生产部署。平台支持可视化实验追踪、定制化评估和告警系统,助力团队打造可靠合规的AI产品,实现持续优化。

主要功能

| 全面的LLM监控 | 自动记录输入、输出、延迟、成本和AI内部决策步骤,提供完整可观测性,便于调试和审计。 |

| 自动化质量评估 | 实时运行可自定义的质量检查与安全评估,内置30多种评测器,并支持人工专家审核。 |

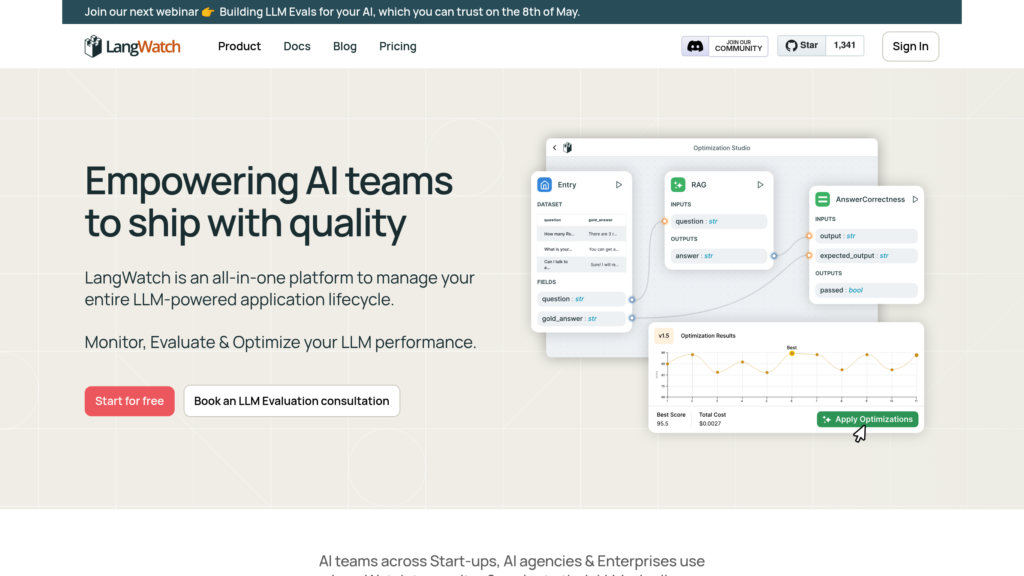

| 优化工作室 | 可视化拖拽界面,用于创建、测试和优化LLM流程,支持自动生成提示词和实验版本管理。 |

| 告警与数据集自动化 | 对性能回退进行实时告警,并可根据标注反馈自动生成数据集,实现模型持续优化。 |

| 自定义分析与业务指标 | 支持构建定制化仪表盘和图表,跟踪AI表现指标,如响应质量、成本和用户交互等。 |

| 企业级与灵活部署 | 开源、模型无关的平台,具备ISO合规、基于角色的访问控制,支持自托管或云端部署。 |

使用场景

- AI质量保障:通过自动化质量检查和引入领域专家评审,确保AI输出一致、安全、准确。

- 风险防控:检测并防止AI幻觉、数据泄露和跑题回答,保护敏感信息与品牌声誉。

- 性能监控:通过可定制分析,跟踪成本、延迟与错误率,优化AI系统效率与用户体验。

- 模型优化:利用优化工作室迭代提示词工程和流程配置,加速从原型到生产的部署。

- 人工闭环评估:无缝集成领域专家,提供手动反馈与标注,提升AI可靠性,实现反馈闭环。