产品概述

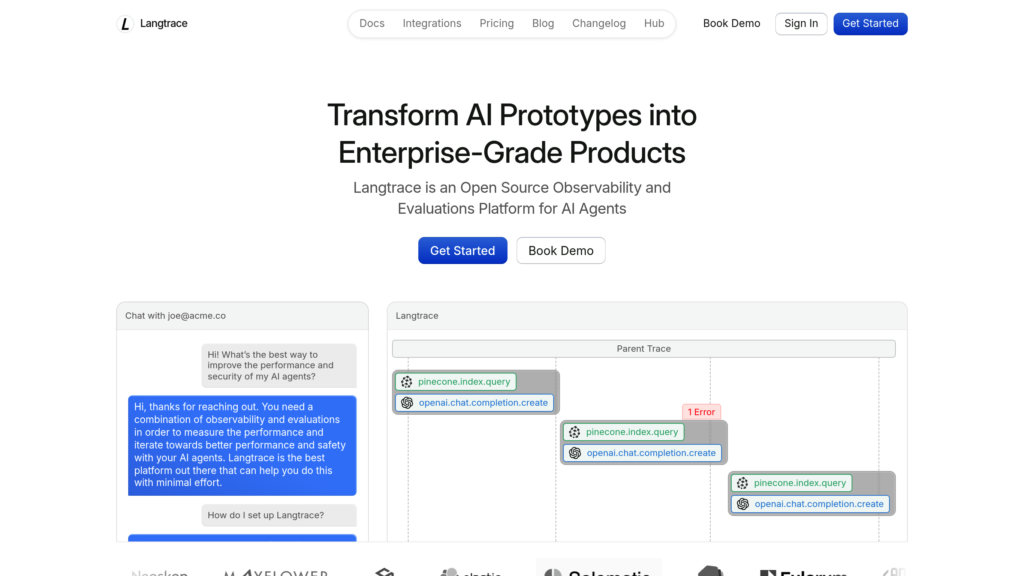

Langtrace是一款面向开发者的开源可观测性工具,提升AI产品(尤其是基于大语言模型的产品)的可靠性与准确率。通过遵循OpenTelemetry标准,Langtrace实现了API调用、延迟、令牌用量、成本和响应准确率的全方位追踪与监控。支持主流LLM、AI框架和向量数据库集成,提供实时仪表盘与评估工具,助力调试和优化AI工作流。SDK集成简单,支持Python和TypeScript,支持云端托管和本地自部署两种方式。Langtrace被广泛应用于开发者从原型到生产级AI系统的高可靠性转型。

主要功能

| 基于OpenTelemetry的追踪 | 采用OpenTelemetry标准,为大语言模型(LLM)、AI框架和向量数据库提供详细且标准化的追踪,实现深度可观测性。 |

| 实时监控与分析 | 动态仪表盘跟踪令牌用量、成本、延迟和准确率等关键指标,助力优化AI应用性能。 |

| 全面评估工具 | 支持对LLM输出的手动与自动评分,帮助衡量并提升AI应用的准确性与可靠性。 |

| 多语言SDK支持 | 提供轻量级Python与TypeScript SDK,便于用户低成本集成。 |

| 灵活的部署选项 | 支持托管SaaS平台和自部署版本,满足不同基础设施需求。 |

| 广泛的集成生态 | 兼容40余种LLM服务商、向量数据库与AI框架,支持复杂AI工作流,如AI Agent和检索增强生成(RAG)。 |

使用场景

- LLM应用可观测性:开发者可监控并追踪大语言模型API调用与工作流,发现瓶颈并优化性能。

- AI Agent与RAG工作流调试:为多组件AI系统提供透明度,帮助开发者理解并优化查询处理与响应生成。

- AI产品准确率提升:通过系统性评估与反馈机制,助力AI应用从原型到生产环境的准确率提升。

- 成本与延迟管理:跟踪令牌消耗与推理延迟,帮助控制运营成本并提升用户体验。

- 自部署可观测性保障隐私:企业可在本地基础设施上部署Langtrace,保障数据自主可控,满足安全合规需求。