产品概述

Prompt Token Counter是一款简洁实用的网页工具,帮助用户统计各类OpenAI语言模型Prompt中的Token数量。由于Token限制直接影响模型性能、成本和输出效果,该工具通过精准计数,帮助用户优化输入。支持所有OpenAI模型,是开发者、研究者和内容创作者高效管理Prompt长度、避免截断或报错的必备工具。

主要功能

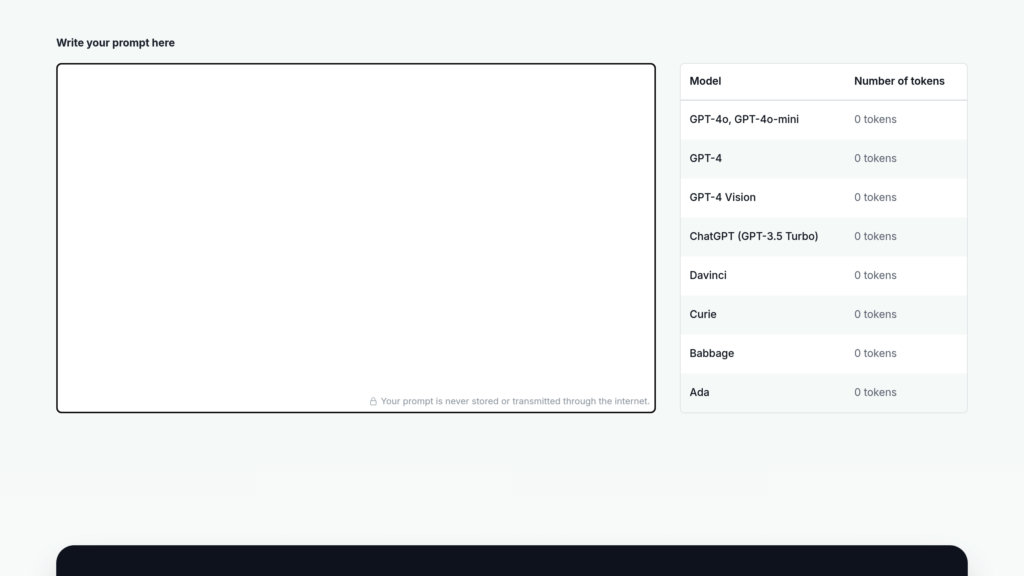

| 精确的Token计数 | 可根据不同OpenAI模型的分词规则,精准计算任意Prompt中的Token数量。 |

| 模型兼容性 | 支持所有OpenAI模型(包括GPT-3.5和GPT-4)的Token计数,适用范围广泛。 |

| 用户友好界面 | 简单直观的网页界面,无需设置即可快速输入并即时获得Token计数结果。 |

| 完全免费 | 完全免费的在线工具,任何需要监控AI Prompt Token用量的用户都可访问。 |

使用场景

- Prompt优化:帮助用户将Prompt调整到Token限制范围内,避免被截断,提升模型输出质量。

- 成本管理:让开发者和企业能够预估Token用量,通过管理Prompt长度来控制API成本。

- AI开发:协助AI开发者和研究人员调试与优化Prompt输入,实现更佳的人机交互。

- 教育工具:作为学习辅助工具,帮助理解分词在语言模型中的作用及其对AI响应的影响。