产品概述

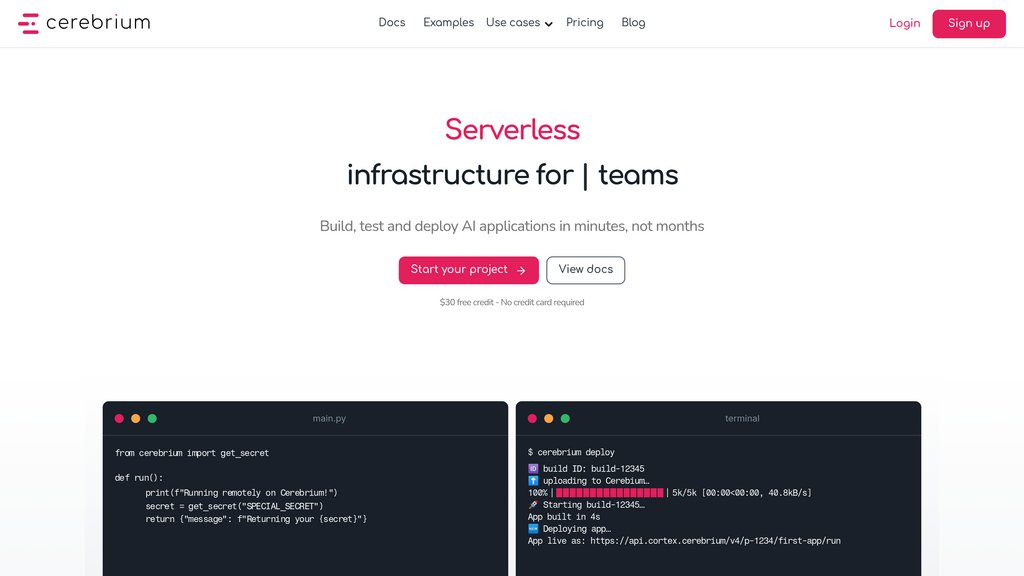

Cerebrium提供全面的无服务器基础设施,旨在简化AI应用程序的构建、部署和扩展。它支持广泛的GPU和CPU选项,使用户能够以最小的延迟运行大规模批处理作业、实时语音应用和复杂的图像和视频处理。该平台强调快速部署、高效自动扩展和强大的可观测性,确保应用程序在不同工作负载下保持高性能和可靠性。凭借企业级安全合规性和实时日志记录,Cerebrium为寻求从原型到生产无缝加速AI项目的团队提供服务。

主要功能

| 无服务器自动扩缩 | 自动扩展AI工作负载以应对流量高峰,无需人工干预即可保持无故障运行。 |

| 多样GPU选择 | 提供超过十二种GPU类型,包括NVIDIA H100、A100和L40s,根据不同AI工作负载优化成本和性能。 |

| 低延迟和快速冷启动 | 确保近乎即时的推理就绪状态,冷启动时间在几秒内,为请求增加的延迟极小。 |

| 全面可观测性 | 提供实时日志记录、健康指标和成本跟踪,以监控部署并优化资源使用。 |

| 企业级安全 | SOC 2和HIPAA合规的基础设施保证数据隐私、安全性和高可用性。 |

| 快速部署 | 使用直观界面和预配置模板,在几分钟内将模型从开发环境部署到生产环境。 |

使用场景

- 大型语言模型部署:通过动态请求批处理和流式输出等功能高效运行和扩展LLM,实现实时响应。

- 语音应用:支持用于客户支持、销售和内容创建的语音到语音AI智能体,具有超低延迟和高并发性。

- 图像和视频处理:利用强大的GPU和分布式缓存进行数字孪生创建、资产生成和视频分析等任务。

- 内容生成和摘要:使用AI生成、翻译和总结多种语言和格式的文本、音频和视频内容。

- 实时AI服务:提供交互式AI驱动的应用程序,延迟最小,确保大规模下的流畅用户体验。