产品概述

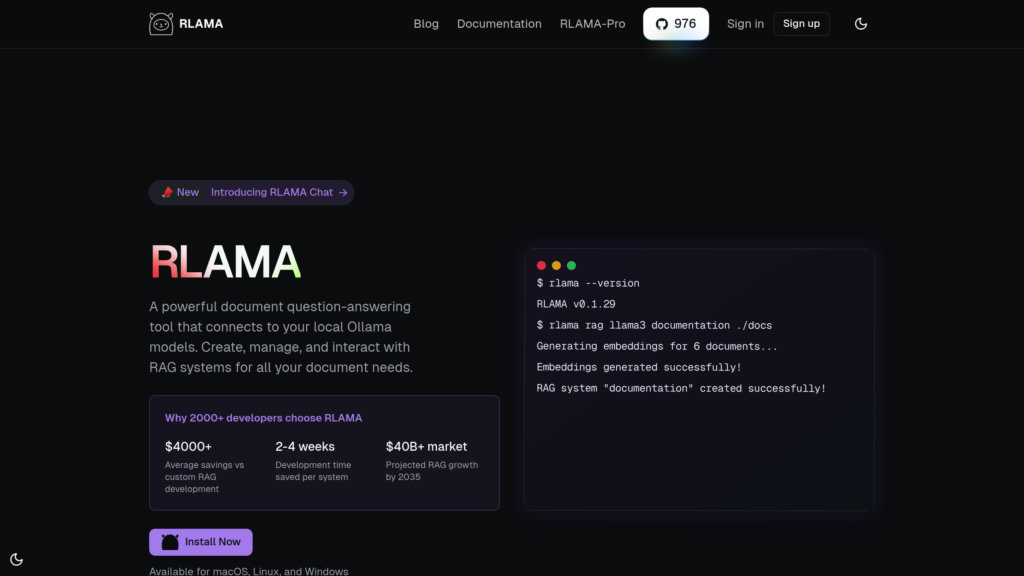

RLAMA 是一款强大的 AI 平台,专为构建、管理和交互式使用检索增强生成(RAG)系统而设计,适用于文档问答场景。系统完全本地运行,所有文档和嵌入均在用户设备上处理,保障隐私和数据安全。RLAMA 支持多种文档格式及高级语义分块策略,优化上下文检索体验。可无缝集成本地 Ollama 模型和 Hugging Face 模型库,灵活选择 AI 能力。此外,RLAMA 还支持网页爬取、目录监控、HTTP API 等功能,便于自动化和集成。跨平台支持 macOS、Linux 和 Windows,适合开发者和企业使用。

主要功能

| 本地优先处理 | 所有文档解析、嵌入生成和查询均在本地完成,数据不会外传,确保隐私和安全。 |

| 多格式文档支持 | 支持多种文档类型,包括文本、Markdown、PDF、Word、Excel、代码文件等,便于灵活构建知识库。 |

| 高级语义分块 | 采用智能分块策略(固定、语义、层级、混合),优化文档检索效果。 |

| 集成 Ollama 与 Hugging Face | 无缝连接本地 Ollama 模型,并支持 Hugging Face 上 45,000 多个 GGUF 模型,灵活选择 AI 模型。 |

| 网页爬取与目录监控 | 可自动从网站和本地目录创建和更新 RAG 系统,打造动态、实时更新的知识库。 |

| API 服务与 CLI 工具 | 提供 RESTful HTTP API 和丰富的命令行工具,便于集成与自动化工作流。 |

使用场景

- 技术文档检索:开发者和工程师可在本地快速检索项目文档、手册和规范。

- 私有知识库:企业可为敏感文档构建安全、私有的 RAG 系统,数据不外泄。

- 科研辅助:科研人员和学生可高效索引和检索论文、教材等学术资料。

- 企业数据集成:RLAMA Pro 支持企业将 RAG 系统与 Snowflake 等数据仓库对接,实现全面数据检索。

- 自定义 AI Agent 创建:用户可构建具备多角色和工具的专用 AI Agent,执行复杂文档任务。