产品概述

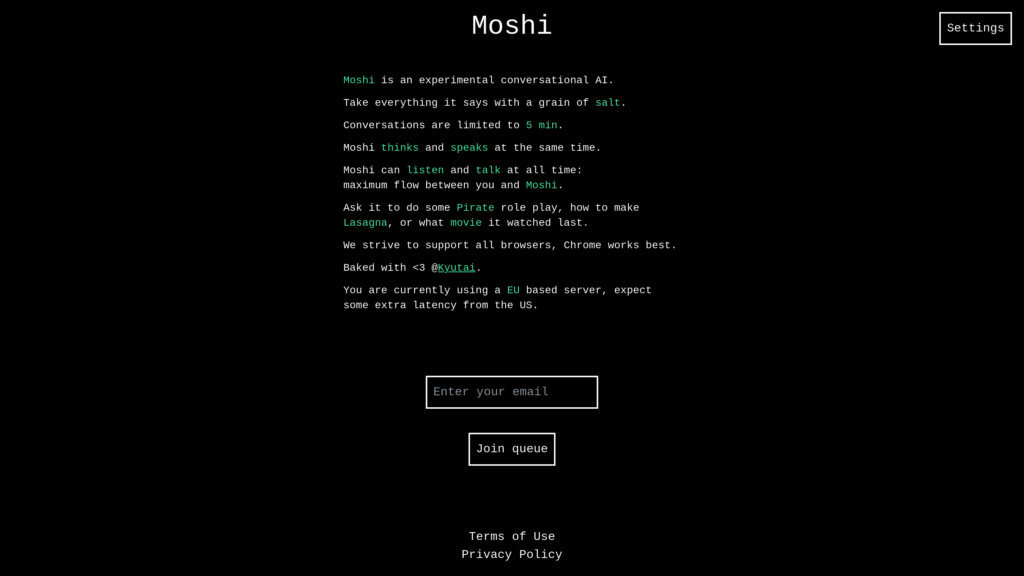

Moshi Chat 由法国非营利AI实验室 Kyutai 开发,是一款先进的实时对话AI平台,支持全双工语音交互,可实现同时听和说。平台集成了7B参数的语言模型 Helium 和最先进的流式神经音频编解码器 Mimi,实现低延迟、自然且富有情感表达的对话。Moshi Chat 支持包括语音、文本和视觉数据在内的多模态输入,专为流畅、具备情感细腻度的人机对话而设计。其开源特性鼓励社区协作和定制,适用于科研、教育、游戏及个人助手等多种应用场景。

主要功能

| 全双工语音交互 | 支持同时听和说,实现无缝、自然的对话体验,延迟极低(约200毫秒)。 |

| 情感识别与表达 | 能够理解并表达多种情感和说话风格,增强交互的真实感与沉浸感。 |

| 多模态输入支持 | 可同时处理语音、文本和视觉信息,为用户带来更丰富、更灵活的交互方式。 |

| 开源且可定制化 | 完全开源,代码和模型可用,用户可自由修改、微调,并在本地或多平台部署。 |

| 高效性能与低延迟 | 针对多种后端(CUDA、Metal、CPU)优化,采用先进缓存技术,可在消费级GPU高效运行。 |

| 多语言与口音支持 | 可理解和输出多种语言及口音,包括细致的语调变化。 |

使用场景

- 个人语音助手:为日常任务、教练指导和陪伴提供实时、具备情感感知的对话支持。

- 互动角色扮演与游戏:为娱乐和教育场景提供富有创意、响应灵活的AI角色动态互动。

- 科研与开发:为AI研究者提供实时语音转文本、文本转语音模型及多模态对话的实验平台。

- 语言学习:通过情感和口音识别,提供沉浸式对话练习,助力语言习得。

- 客户服务自动化:可用于实时、自然的客户互动,具备情感智能和快速响应能力。